数据统计埋点工作框架及细节规范——在线数据处理与交易处理业务的实施指南

随着在线数据处理与交易处理业务的快速发展,数据统计埋点已成为支撑业务决策、优化用户体验和提升系统性能的关键环节。为确保数据采集的准确性、完整性和一致性,本文基于行业实践,提出一套全面的数据统计埋点工作框架及细节规范。

一、埋点工作框架设计

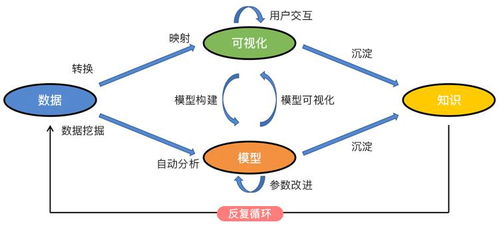

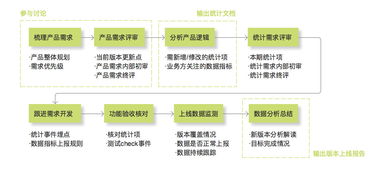

数据统计埋点工作框架应从业务目标出发,结合数据生命周期,涵盖规划、实施、验证和维护四个阶段。具体框架如下:

- 规划阶段:明确埋点目标与范围

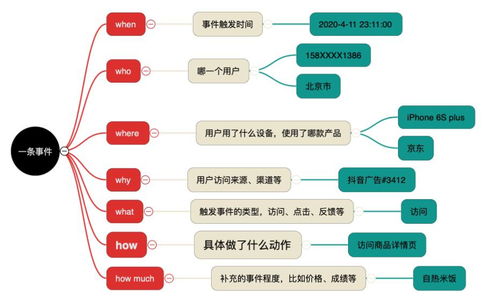

- 业务需求分析:识别关键业务指标(如用户转化率、交易成功率等),确保埋点与业务目标对齐。

- 数据范围定义:确定需要采集的数据维度,包括用户行为、交易流程、系统性能等。

- 实施阶段:开发与部署埋点代码

- 技术选型:根据业务场景选择合适的数据采集工具(如自研SDK、第三方平台如神策或GrowingIO)。

- 代码规范:制定统一的埋点命名规则(例如事件ID格式、参数命名),避免数据冗余和歧义。

- 验证阶段:数据质量监控

- 测试验证:在预发布环境中模拟用户行为,确保埋点数据准确触发和传输。

- 实时监控:建立数据异常报警机制,及时发现并修复埋点问题。

- 维护阶段:持续优化与文档管理

- 版本控制:跟踪埋点变更历史,确保与业务迭代同步。

- 文档更新:维护埋点字典,详细记录每个事件的定义、参数和业务逻辑。

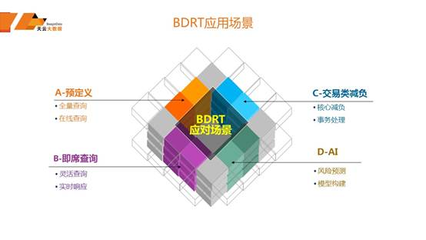

二、在线数据处理与交易处理业务的细节规范

针对在线数据处理与交易处理业务,埋点规范需重点关注数据安全、实时性和业务连续性,具体包括:

- 数据安全与合规

- 敏感信息脱敏:对用户身份、交易金额等敏感数据采用加密或哈希处理,遵守GDPR、数据安全法等法规。

- 权限控制:限制数据访问权限,确保只有授权人员可操作埋点数据。

- 交易流程埋点规范

- 关键事件定义:覆盖用户从登录、浏览、下单到支付的全流程,例如事件包括“pageview”、“addtocart”、“paymentsuccess”。

- 参数标准化:统一使用参数如“userid”、“orderid”、“transaction_amount”,便于数据聚合分析。

- 实时数据处理

- 低延迟采集:采用异步上报机制,减少对主业务流程的影响,确保交易数据及时上传。

- 数据一致性:通过事务机制或去重逻辑,避免重复或丢失数据,保证统计结果的可靠性。

- 性能与可扩展性

- 资源优化:控制埋点频率和数据量,防止过度采集导致系统负载过高。

- 扩展设计:支持动态配置埋点,适应业务快速迭代,例如通过配置中心调整事件触发条件。

三、最佳实践与注意事项

- 跨部门协作:与产品、开发和运营团队紧密沟通,确保埋点需求被正确理解和实施。

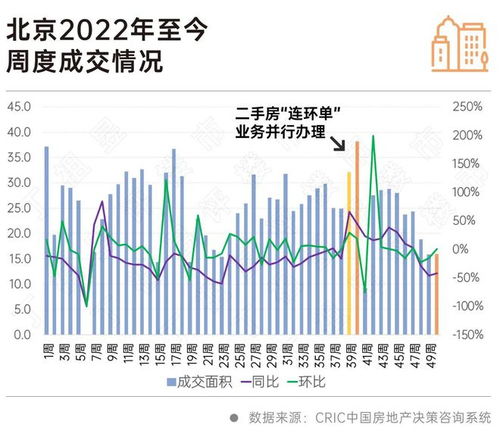

- 数据驱动决策:定期分析埋点数据,识别业务瓶颈,例如通过交易失败率优化支付流程。

- 工具集成:将埋点系统与数据分析平台(如ELK栈、数据仓库)集成,提升数据处理效率。

在在线数据处理与交易处理业务中,一个结构化的埋点工作框架和细节规范是保障数据质量的基础。通过遵循以上指南,企业可以高效采集关键数据,驱动业务增长,同时确保合规与安全。未来,随着AI和实时分析技术的发展,埋点工作将更加智能化,助力企业实现精细化运营。

如若转载,请注明出处:http://www.shuzicunzhi.com/product/19.html

更新时间:2025-11-29 18:35:03